Che cos’è un verificatore di Sitemap?

XML Sitemap Finder è uno strumento per verificare se un sito ha una mappa XML.

Potete usare Google Sitemap Checker per verificare se il vostro sito web ha una mappa XML e per identificare eventuali errori. Se lo strumento trova dei bug, vi dirà come risolverli.

L’XML Sitemap Checker può assistervi in diverse aree chiave:

- Verifica la presenza di un file XML sul vostro sito.

- Rileva eventuali problemi all’interno del file xml della mappa del vostro sito.

- Migliora l’efficienza con cui i motori di ricerca indicizzano il vostro sito.

- Migliora l’efficienza con cui i motori di ricerca indicizzano il vostro sito.

Caratteristiche principali di Sitemap Tester

Dashboard unificato. Una dashboard unificata fornisce un’unica visione dei dati tecnici SEO, rendendo più semplice il monitoraggio e la gestione delle loro prestazioni.

Interfaccia user-friendly. L’interfaccia user-friendly rende facile l’uso di Sitechecker, anche se non si è esperti di tecnica.

Un set completo di strumenti SEO. Lo strumento di ricerca della Sitemap fa parte di un set completo di strumenti SEO che può aiutarvi a migliorare il posizionamento del vostro sito web nelle pagine dei risultati dei motori di ricerca (SERP).

Come utilizzare lo strumento di ricerca delle Sitemap XML

Fortunatamente, non è necessario controllare manualmente il codice del vostro sito web per capire se è presente il file che elenca le pagine essenziali di un sito web. Con l’aiuto di Sitemap Detector, è possibile consultare qualsiasi sito per ottenere queste informazioni.

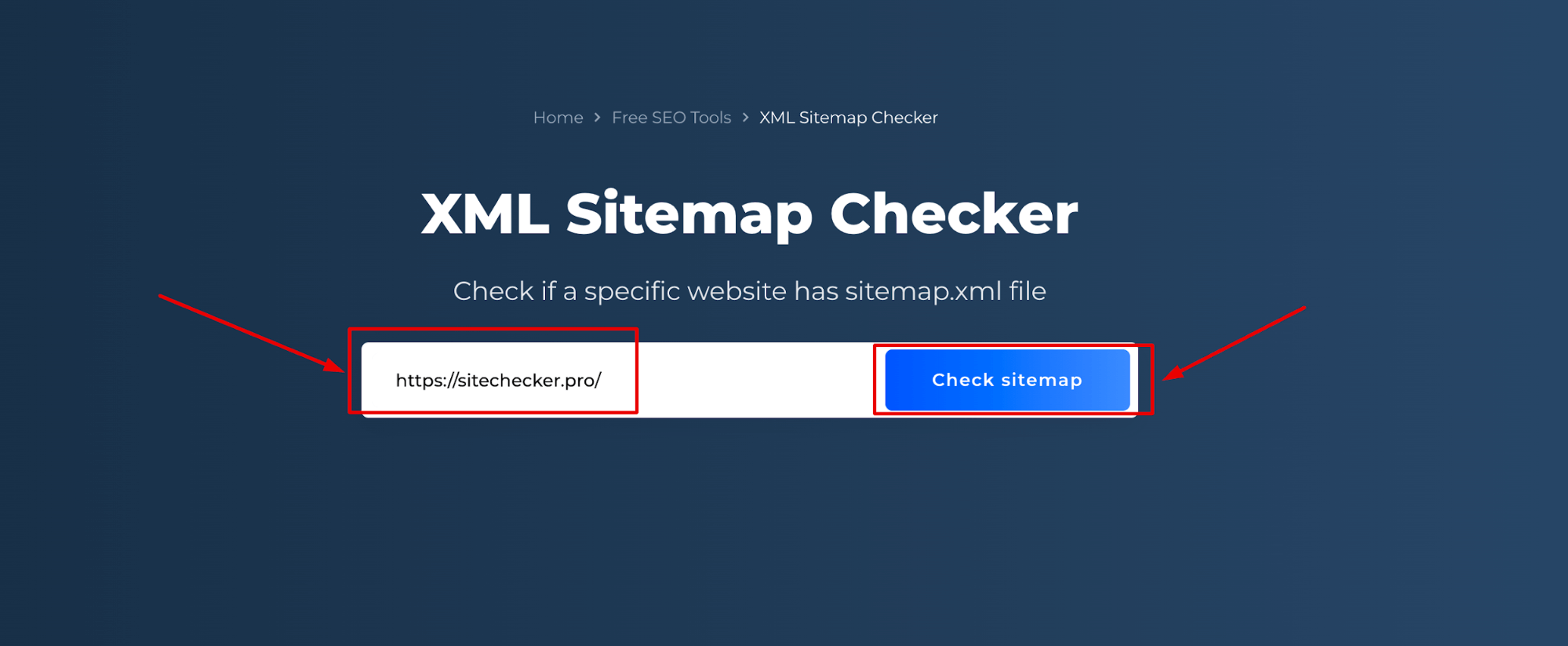

Fase 1: Inserire il nome del dominio

Il primo passo consiste nell’inserire l’URL del vostro sito web:

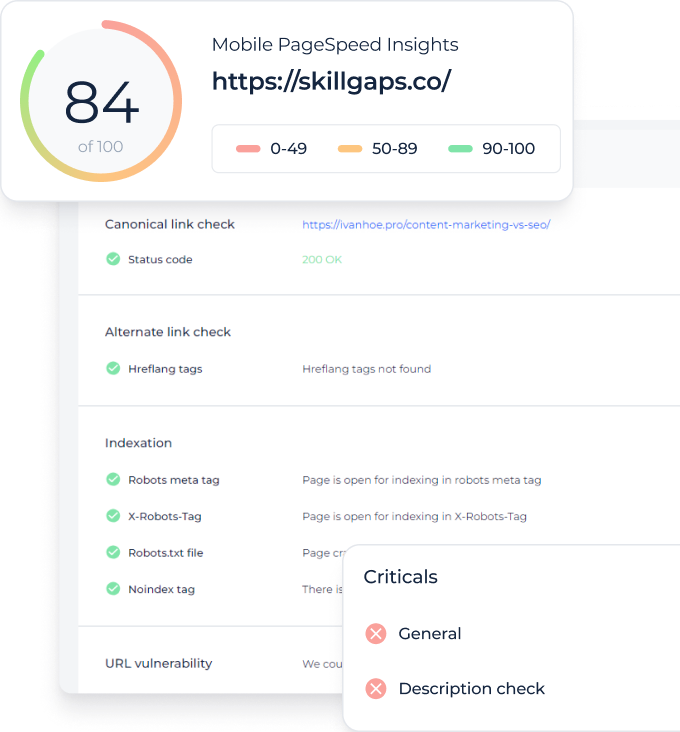

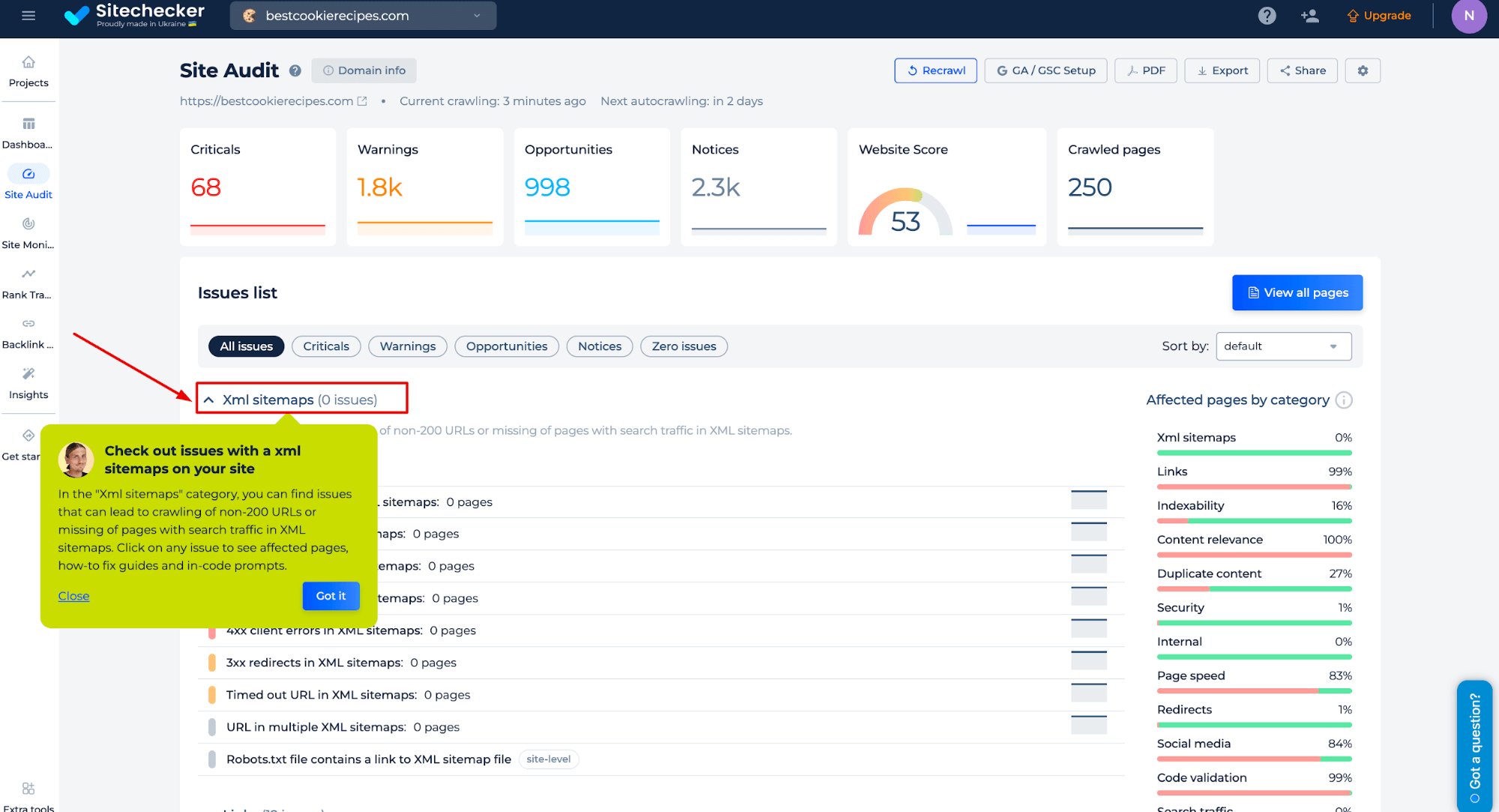

Fase 2: Interpretare i risultati di Sitemap Tester

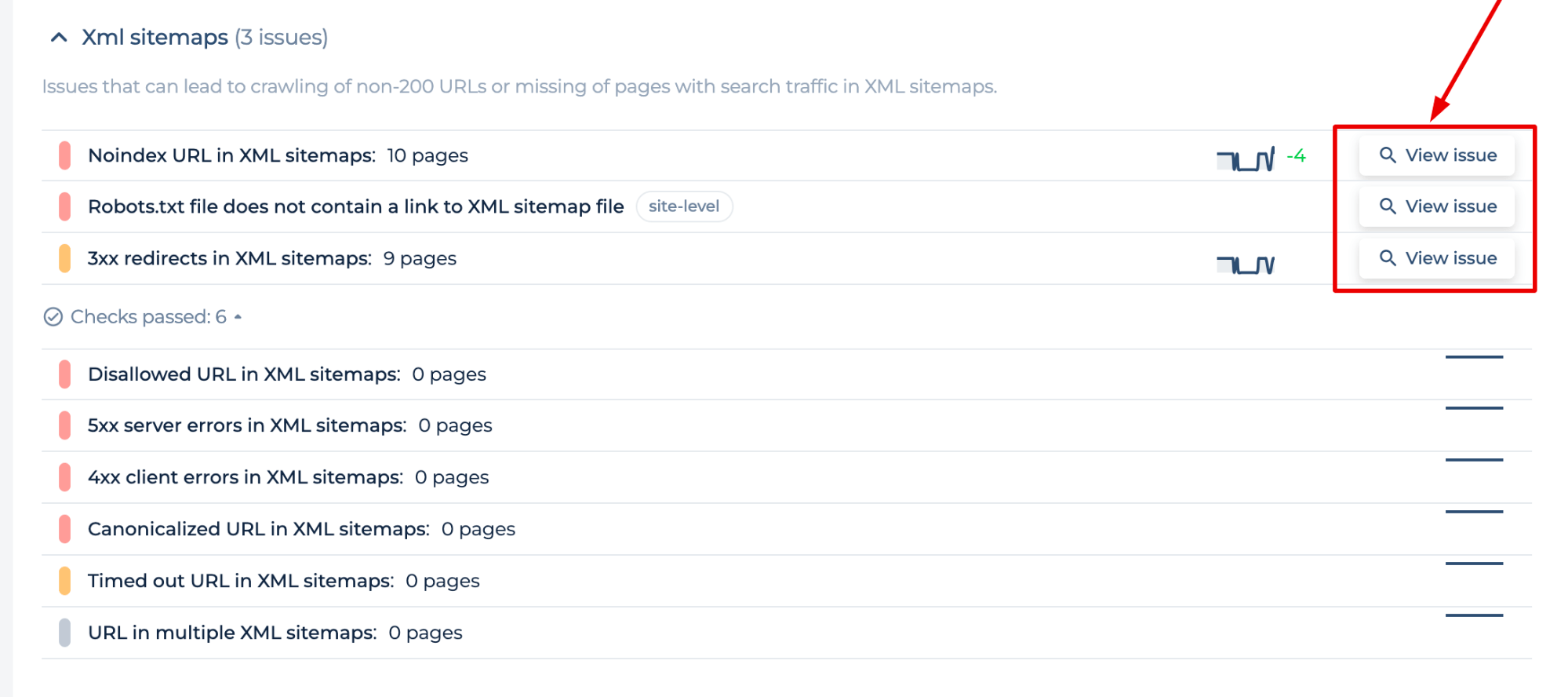

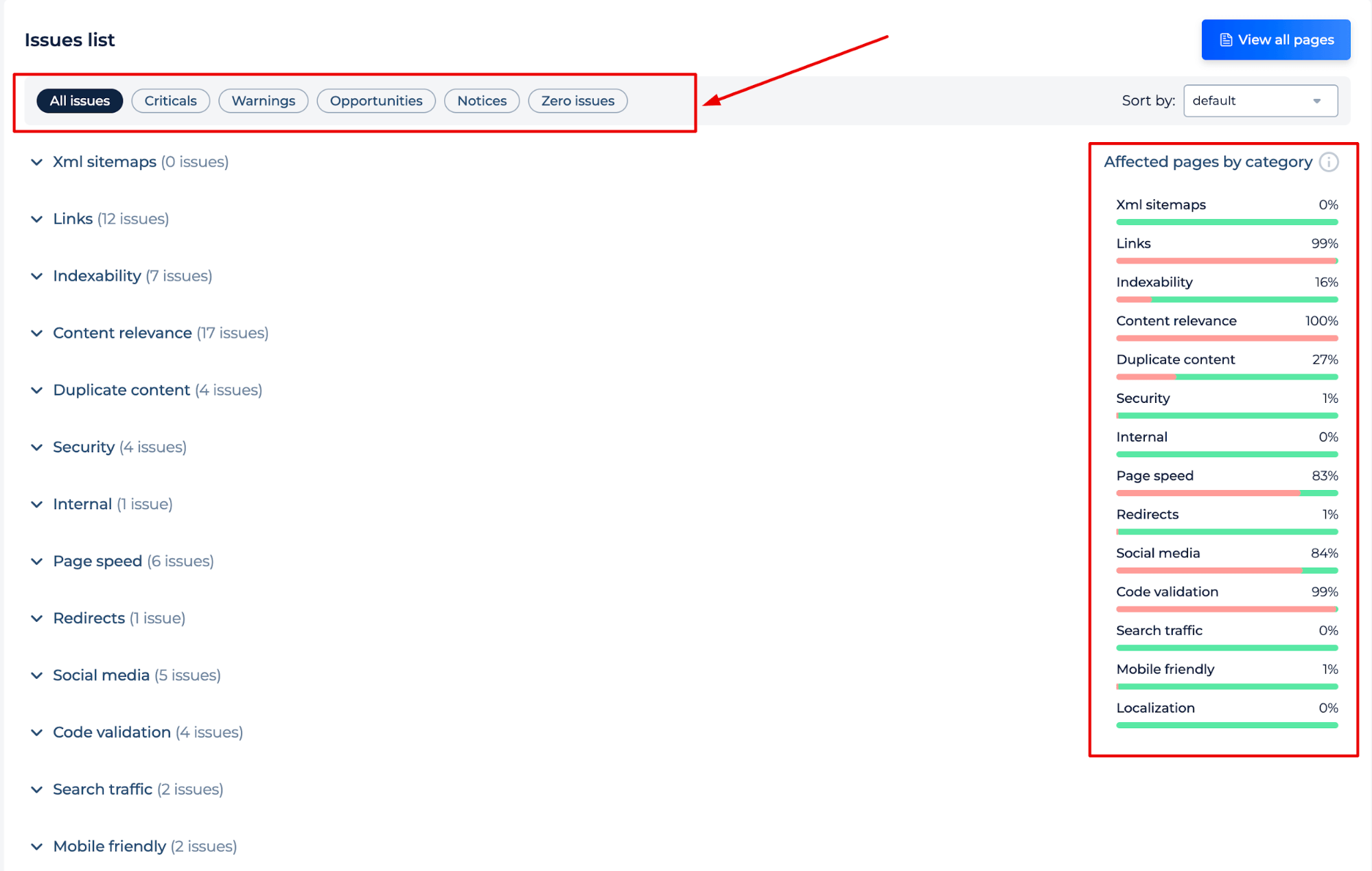

La scansione eseguita genera una verifica del sito per il dominio inserito. Nella categoria “Sitemap XML” è possibile trovare i problemi che possono portare al crawling di URL non-200 o alla mancanza di pagine con traffico di ricerca nelle mappe XML. Fare clic su un problema per visualizzare le pagine interessate, le guide alla correzione e i suggerimenti per il codice.

Il tester delle sitemap consente di identificare gli errori delle sitemap e di ottenere istruzioni su come risolverli per ridurre l’impatto degli errori delle sitemap sull’indicizzazione:

- Un URL con codice di stato non 2xx nella sitemap (3xx redirect, 5xx errori del server, 4xx errori)

- Noindex URL e Disallowed URL

- File Robots.txt senza link alla sitemap XML, URL in XML multipli, File Sitemap.xml troppo grande, ecc.

.

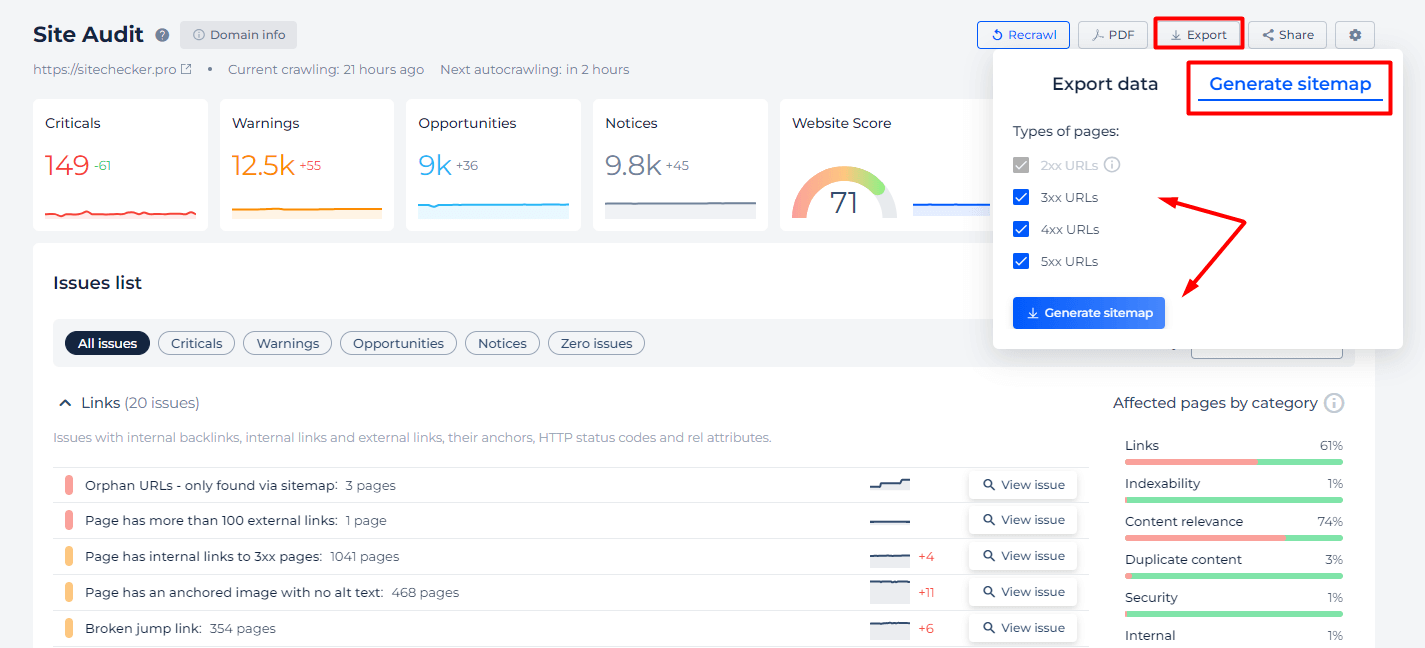

Inoltre, offriamo funzioni specifiche nel caso in cui non siate sicuri che tutte le pagine siano incluse nella vostra sitemap, o se desiderate semplicemente utilizzare il nostro strumento come validatore di sitemap XML. Utilizzare le schede “Esportazione” e “Genera sitemap” per selezionare i tipi di URL in base al codice di stato da includere nella mappa.

Funzioni aggiuntive di XML sitemap checker

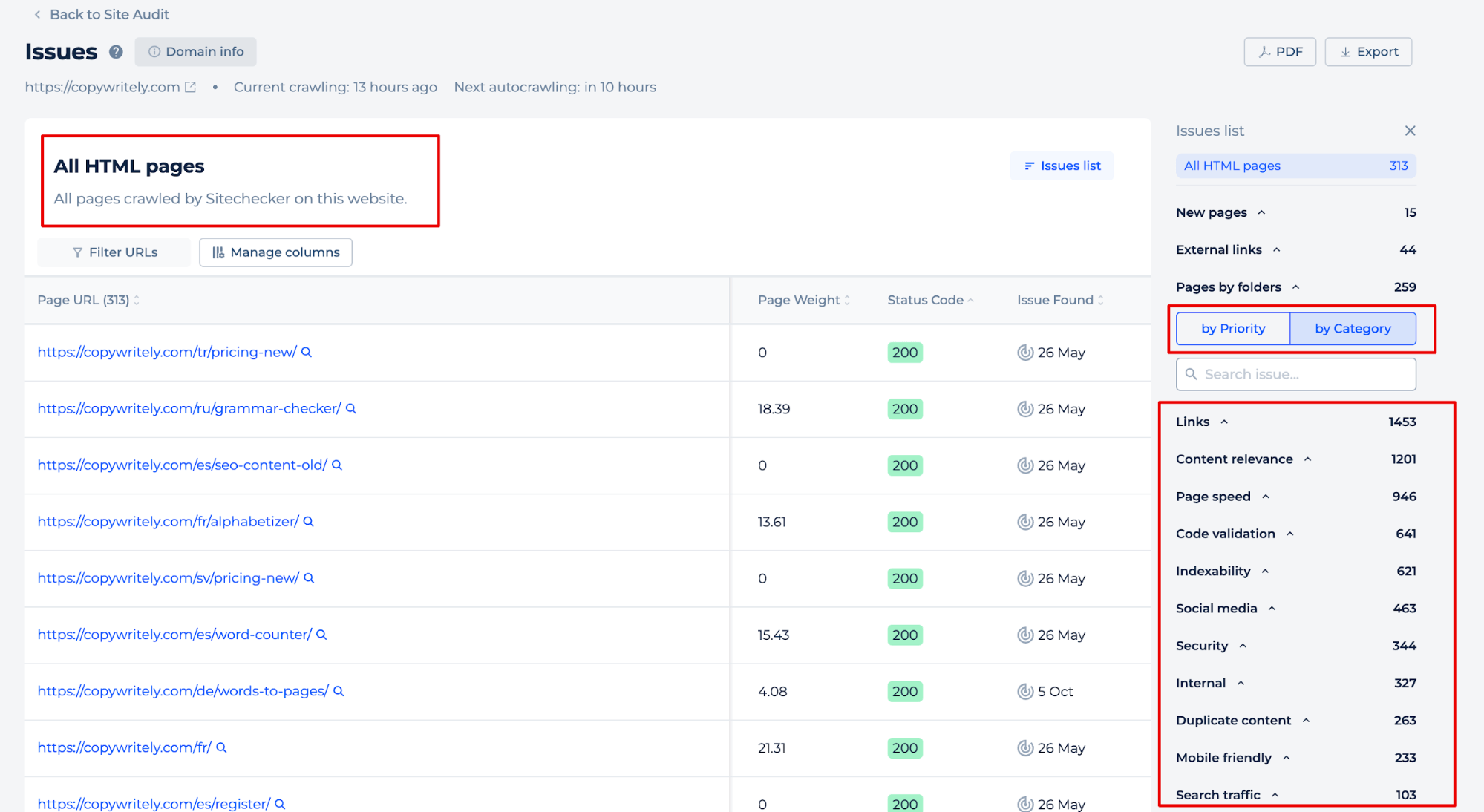

Dopo il crawling del sito, riceverete anche un rapporto completo di verifica del sito, che evidenzia ogni potenziale problema e fornisce istruzioni su come risolverlo. Il rapporto è ordinato per tipo o categoria di problema, consentendovi di affrontare in modo efficiente i problemi più cruciali per il successo del vostro sito.

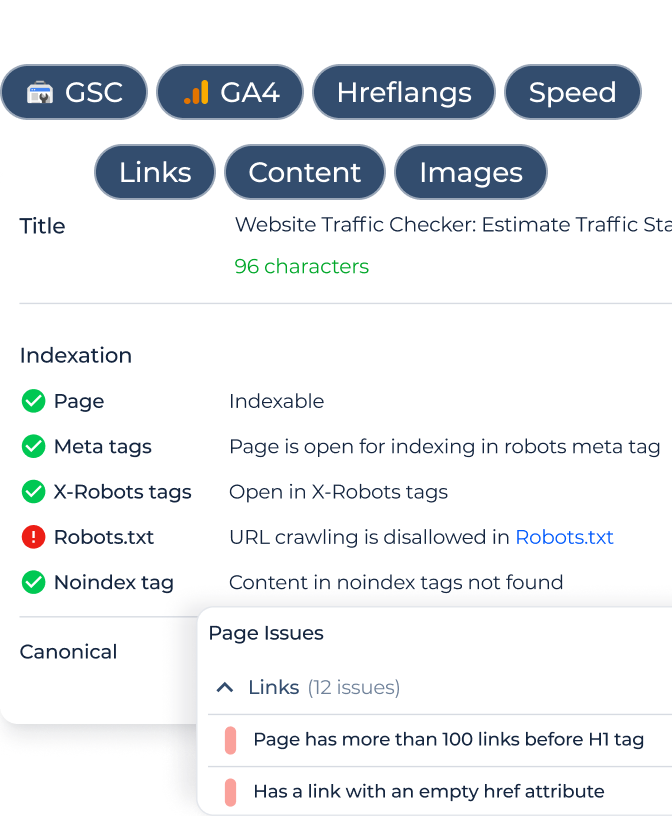

Facendo clic sul pulsante “Visualizza tutte le pagine”, è possibile identificare i problemi sulle singole pagine. Ordinate i problemi per priorità o categorie o aggiungete manualmente i dati alle pagine che vi interessano.

Idea finale

Il Website Sitemap Checker è uno strumento progettato per garantire che un sito abbia un file XML, identificare eventuali errori presenti e contribuire a migliorare l’efficienza dell’indicizzazione del sito nei motori di ricerca. Offre un’interfaccia facile da usare all’interno di una dashboard unificata per una facile gestione SEO, come parte di un set completo di strumenti SEO. Lo strumento semplifica il processo di verifica di una mappa del sito inserendo un nome di dominio e analizzando i risultati, che includono un rapporto di verifica completo con istruzioni dettagliate per la correzione dei problemi individuati. Questo aiuta a mantenere un sito ben strutturato e ottimizzato per la SEO.